Estar atento aos perigos do YouTube pode ser o segredo para defender as crianças. O site de partilha de vídeos tem tanto de bom como de mau mas, infelizmente, a parte negativa pode mesmo pôr em risco a vida dos mais pequenos ou colocá-los em situações complicadas ou traumáticas.

Já imaginou o que pode acontecer se, de repente, a meio dos desenhos animados, aparecer um pequeno vídeo de um homem a explicar como é que as crianças podem cortar os pulsos? Por mais estranho que pareça, isto aconteceu (ou ainda acontece).

Free Hess descobriu o vídeo no YouTube Kids, uma plataforma criada para as crianças. A descrição era de um “vídeo familiar”, mas a verdade é que, a meio, um homem explicava detalhadamente quais os passos que as crianças deviam tomar para “obter resultados”.

No blogue pessoal, a mãe e pediatra em Gainesville, na Florida, alertou para o facto de o suicídio ser a “segunda principal causa de morte em indivíduos entre os 10 e os 34 anos, e o número de crianças que apresentam alguma forma de automutilação está a crescer rapidamente”.

O vídeo em questão terá sido apagado pelo YouTube Kids depois de a mulher ter denunciado o caso. No entanto, este não era o único e, na plataforma, ela descobriu outro destes vídeos exatamente com o mesmo conteúdo: um vídeo a ensinar como uma criança podia suicidar-se dentro de um filme de desenhos animados.

A particularidade neste caso é que esse mesmo vídeo já tinha comentários com oito meses em que vários utilizadores pediam para a plataforma apagar o conteúdo. Dias depois de o caso ter repercussão na comunicação social e nas redes sociais, o YouTube removeu o vídeo afirmando que este violava os seus termos de serviço.

“A exposição a vídeos, fotos e outros conteúdos que causam danos pessoais e suicidas é um grande problema que nossos filhos enfrentam hoje”, disse a pediatra, alertando para o facto de estes poderem não ser os únicos vídeos com este tipo de conteúdo no site. “Vi muitos vídeos diferentes, tanto no YouTube como no YouTube Kids, de conteúdos como automutilação, cortes, suicídio e imagens violentas”, disse em entrevista à Fox4.

O YouTube respondeu à ABC News e explicou que trabalha todos os dias para evitar que este tipo de vídeos sejam carregados, através de “tecnologia de sinalização do utilizador e deteção inteligente para sinalizar esse conteúdo”, acrescentando que remove milhões de vídeos que violam as políticas.

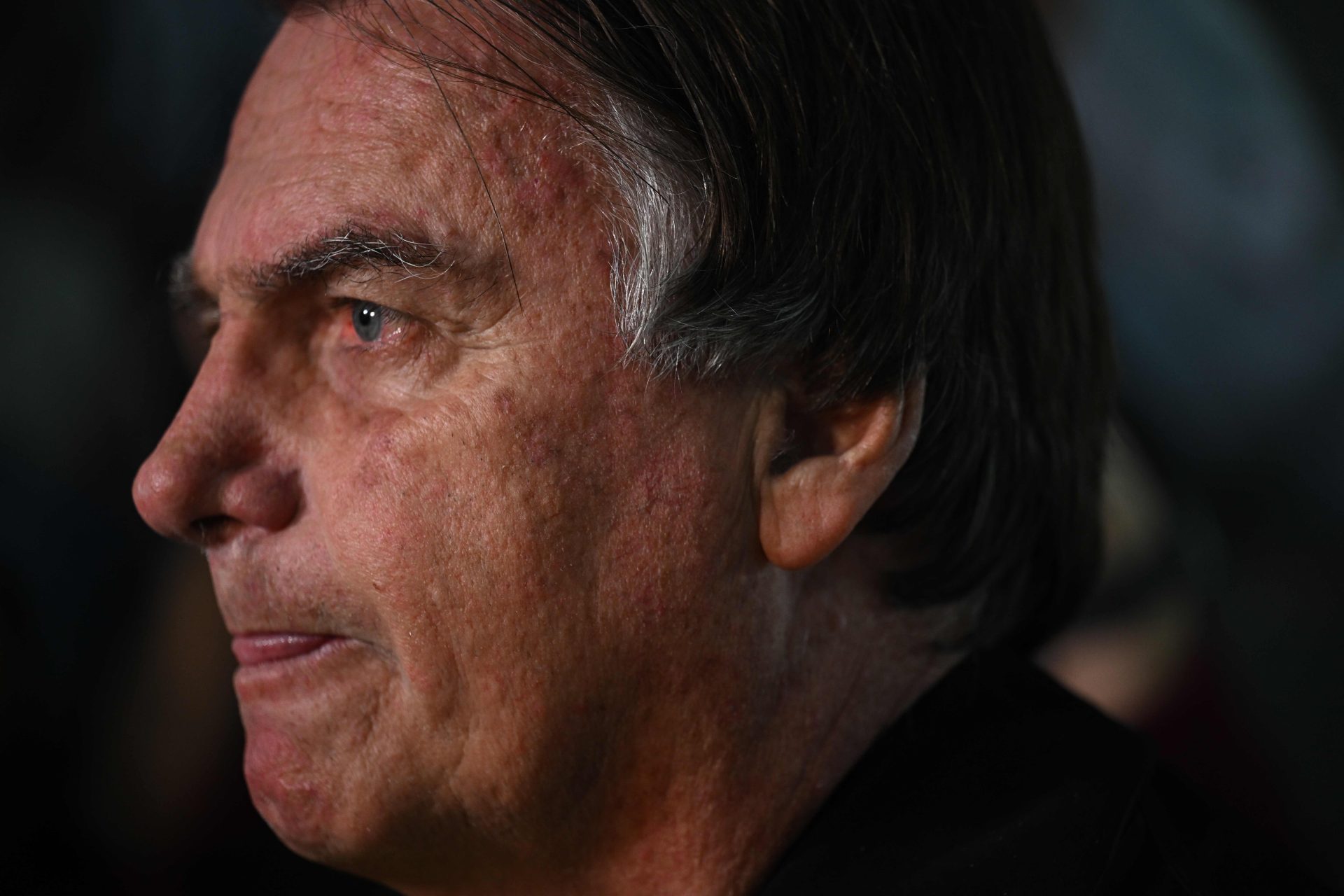

A pedofilia À vista de todos Uma rede de pedofilia foi desvendada pelo youtuber Matt Watson (conhecido como MattWhatItIs) e ganhou um maior destaque quando Felipe Neto, segundo maior youtuber do Brasil, falou sobre o caso.

Para esta rede funcionar, utilizadores com contas falsas comentavam vídeos de crianças, algumas com menos de dez anos, indicando qual o minuto exato em que estas se encontravam em posições que poderiam ser sexualizadas. Estes vídeos são muitas vezes inocentes, com crianças a brincar ou a fazer ginástica, mas os pedófilos são “canalizados” para o preciso momento em que a criança mostra as cuecas, põe a língua de fora, morde o lábio e por aí fora.

Além dos conteúdos, o YouTube acaba por facilitar este tipo de comportamentos, tudo por causa do algoritmo. A partir deste, quando um utilizador assiste a um vídeo, na barra lateral aparecem recomendações que têm algo em comum com o tipo de conteúdos que o utilizador costuma procurar.

Em ambos os vídeos, os youtubers explicam qual o método mais eficaz para chegar a este tipo de conteúdos. A partir de palavras e passos específicos, qualquer utilizador chega a uma coluna de recomendações recheada de vídeos de crianças com milhares de reproduções, embora se trate de crianças desconhecidas.

O YouTube também reagiu a esta polémica, garantindo ter desativado os “comentários de milhões de vídeos que incluem menores”, eliminado 400 perfis e que os denunciou às autoridades.

A empresa garantiu também ter eliminado “dezenas de vídeos” que colocavam em risco os menores. Lembra também que menores de 13 anos não podem criar contas e que são milhares os canais excluídos todas as semanas por esse motivo.

Várias foram as marcas que anunciaram retirar a publicidade da plataforma. Entre elas estão Nestlé, Doctor Oetker, Disney e a produtora de jogos, como o Fortnite, Epic Games. Em causa está a forma como o YouTube trata este tipo de casos. Isto acontece depois de, nos últimos anos, algumas empresas já se terem afastado da plataforma por não quererem que os seus anúncios apareçam junto a conteúdo sensível, por considerarem que isso é prejudicial para a sua imagem.

Este cenário já tinha acontecido em 2017, quando várias empresas retiraram os anúncios do YouTube depois de uma polémica com vídeos violentos e extremistas.

Perigos na Porquinha Pepa Um desafio idêntico à Baleia Azul, que incentiva a ações que podem pôr em perigo quem o aceita, através de vários passos, chegou no ano passado ao WhatsApp. Agora em vídeos de desenhos animados infantis Porquinha Pepa e de Fortnite, as crianças estão a assistir a imagens assustadoras e pequenos clipes de sons perturbadores. A boneca chama-se Momo, uma mulher de face assustadora, com olhos grandes, de cabelo preto comprido e sorriso assustador, que ameaça as crianças com uma maldição caso estas não façam o que pede.

Segundo o “Daily Mail”, o alerta foi dado por centenas de pais no Reino Unido que, através de comunicado escolar, alertaram para o facto de vídeos “altamente inapropriados” circularem no YouTube e YouTube Kids.

Um desses vídeos começa de forma bastante inocente, como todos os vídeos da famosa Porquinha Pepa, mas a dada altura transforma-se numa versão alterada, violenta e ofensiva. Outro desses vídeos incentiva as crianças a fazerem certas coisas sem contar aos pais.

Há ainda relatos de uma mãe que foi chamada à escola devido a ameaças por parte do filho. Só depois de discutir com a criança percebeu que a Momo lhe tinha dado certas instruções.

No entanto, a Sociedade Britânica para a Prevenção da Crueldade contra Crianças (NSPCC na sigla inglesa) pede agora que não se dê voz a este tipo de assuntos e afirma mesmo que não há registo de suicídios ou danos físicos devidos a este novo desafio viral.