O desenvolvimento da inteligência artificial (AI) e da robótica é uma questão cada vez mais premente e a relação da humanidade com esta tecnologia tem acendido debates e levado a tomadas de posição de alguns dos principais intervenientes.

Há quem defenda o rápido desenvolvimento da AI e outros dizem que se deve pôr um travão, sob pena de se perder o controlo. Quando se fala de armas – muita delas já em desenvolvimento –, a questão assume ainda mais importância.

A ideia de haver uma proliferação de carros de combate, metralhadoras e drones que pensam por si mesmos está a deixar muitas pessoas inquietas. Numa carta aberta com data de ontem, um grupo de especialistas de 26 países advogam uma resolução da ONU para banir o de-senvolvimento e utilização de armas autónomas, de forma a prevenir o início de uma corrida para a construção de robôs assassinos. Há pouco tempo, as Nações Unidas votaram o início formal de discussões sobre o tema.

Na carta pública, assinada por, entre outros, o CEO da Tesla, Elon Musk, ou o cofundador da DeepMind, Mustafa Suleyman , bem como outros responsáveis de empresas de robótica e de inteligência artificial, lê-se que quando as armas autónomas estiverem desenvolvidas vão “permitir que os conflitos armados sejam travados numa escala maior do que nunca e em escalas de tempo mais rápidas que aquelas que os humanos conseguem compreender. Estas poderão ser armas de terror, armas que os déspotas e os terroristas usam contra populações inocentes, e armas ‘hackadas’ para se comportarem de forma indesejável. Não temos muito tempo para agir. Quando esta caixa de Pandora estiver aberta, será difícil fechá-la”.

Terceira revolução Na carta, divulgada a propósito da Conferência Internacional Conjunta sobre Inteligência Artificial, que ontem começou em Melbourne, Austrália, os assinantes avisam que a corrida ameaça tornar-se a “terceira revolução do combate armado”, depois da pólvora e das armas nucleares.

Os especialistas defendem que os sistemas de armas autónomas devem ser incluídos na lista de armas proibidas pela Convenção da ONU para Certas Armas Convencionais, instituída em 1983 e na qual se incluem as armas químicas e algumas armas laser.

Já numa carta aberta anterior, com data de 2015, alguns dos mesmos especialistas alertavam para que “as armas autónomas selecionam e atacam alvos sem intervenção humana. (…) A tecnologia da inteligência artificial chegou ao ponto de desenvolvimento de este tipo de sistemas ser viável, não daqui a décadas, mas daqui a alguns anos”.

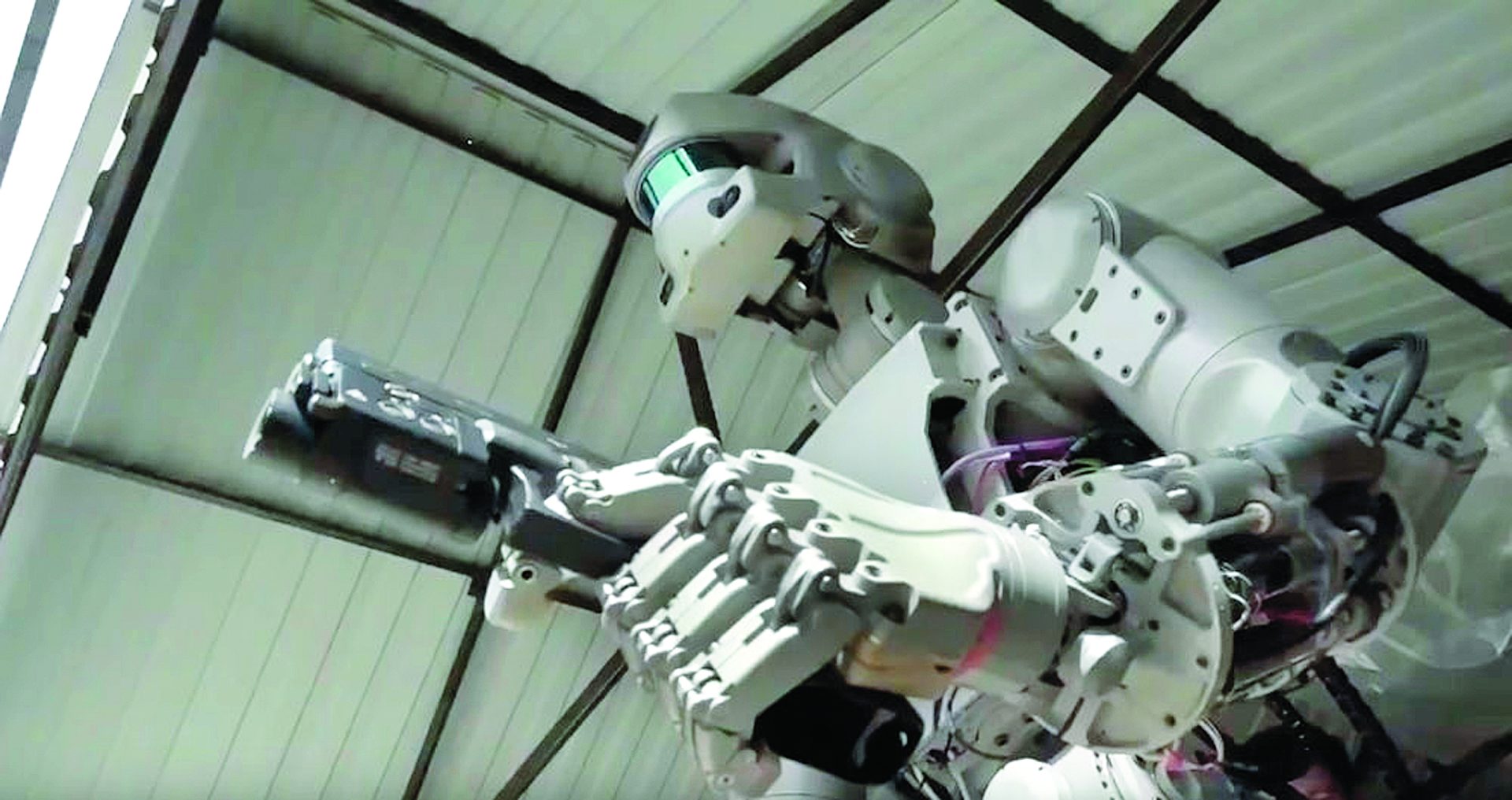

Os especialistas dizem que qualquer tecnologia pode ser usada para o bem e para o mal, e que a AI não é diferente. Pode ser usada para lidar com muitos dos problemas das sociedades contemporâneas, desde a desigualdade à crise financeira global, passando pelas alterações climatéricas. Mas é a mesma tecnologia que pode ser usada para industrializar a guerra. E enquanto muita da AI atual continua no âmbito da ficção científica, os sistemas de armamento autónomos estão na vanguarda do desenvolvimento.

Vigilância De acordo com o diário britânico “The Guardian”, há vários destes exemplos. A SGR-A1, uma arma de vigilância desenvolvida pela sul-coreana Samsung, está colocada na fronteira entre a Coreia do Sul e a Coreia do Norte. A arma é a primeira do género, com um sistema autónomo de vigilância, reconhecimento de voz, acompanhamento de um alvo e disparo.

Mas há outros protótipos de armas autónomas para o combate aéreo, naval e terrestre. O drone britânico Taranis, desen-volvido pela BAE Systems, terá capacidade para incorporar autonomia completa.

A Rússia, os EUA e outros países estão a desenvolver carros de combate robóticos que poderão ser controlados remotamente ou funcionar com autonomia.

O Sea Hunter, navio autónomo da marinha de guerra norte-americana, foi lançado em 2016. Ainda na fase de desenvolvimento, tem como objetivo ter capacidades de combate que incluam a luta antissubmarina.

Antecipar a complexidade das relações entre os robôs e os humanos sob a forma de leis Isaac Asimov, o grande escritor russo de ficção científica, escreveu em 1950 o livro “Eu, Robot”, com o qual tentou antecipar a complexidade da inteligência artificial e da sua relação com os seres humanos.

A partir de casos particulares, Asimov constrói um futuro no qual as máquinas tomam as suas próprias decisões e no qual a vida dos humanos é impossível sem a ajuda dos robôs.

Este é o livro no qual Asimov escreve também as suas famosa ‘Leis da Robótica’ e que procuram ser respeitadas pelas pessoas que estão a investigar e a desenvolver a inteligência artificial.

São três as ‘Leis da Robótica’:

1. um robô não pode ferir um humano ou permitir que um humano sofra algum mal;

2. os robôs devem obedecer às ordens dos humanos, exceto nos casos em que tais ordens entrem em conflito com a primeira lei;

3. um robô deve proteger sua própria existência, desde que não entre em conflito com as leis anteriores.

Mais tarde, no livro “Os Robôs e o Império”, Asimov acrescentou a Lei Zero da Robótica: um robô não pode causar mal a humanidade ou, por omissão, permitir que a humanidade sofra algum mal, nem permitir que ela própria o faça.

Coexistência De acordo com o próprio Asimov, o objetivo das leis era tornar possível a coexistência de robôs inteligentes – as leis pressupõem inteligência suficiente para os robôs tomarem suas próprias decisões – e humanos; impedindo assim que os robôs se revoltassem contra estes últimos ou que viessem mesmo a subjugar os humanos.

O livro “E, Robot” marcou o início do fim da ficção científica apenas no domínio da ficção para entrar no campo da discussão ética sobre a relação da humanidade com a tecnologia.